وبلاگ / یادگیری انتقالی چیست؟ کاربردها، مزایا و پیادهسازی عملی

یادگیری انتقالی چیست؟ کاربردها، مزایا و پیادهسازی عملی

مقدمه

تصور کنید یک پزشک متخصص قلب بخواهد در حوزه ریه تخصص پیدا کند. آیا باید تمام دانش پزشکی خود را فراموش کند و از ابتدا شروع کند؟ مسلماً نه! او میتواند از دانش آناتومی، فیزیولوژی و تجربیات بالینی خود استفاده کند و فقط روی تفاوتهای خاص ریه تمرکز کند. این دقیقاً همان چیزی است که یادگیری انتقالی (Transfer Learning) در دنیای هوش مصنوعی انجام میدهد.

یا تصور کنید میخواهید به کودکتان بیاموزید که گربه را تشخیص دهد. آیا نیاز است ابتدا مفهوم "حیوان" را از صفر یاد بگیرد؟ خیر! او قبلاً میداند که سگ یک حیوان است، چشم دارد، دم دارد و حرکت میکند. حالا فقط باید یاد بگیرد که گربه هم همین ویژگیها را دارد اما با تفاوتهایی مثل صدای "میو" یا چنگالهای برندهتر. این فرآیند طبیعی یادگیری انسان، الهامبخش یکی از قدرتمندترین تکنیکهای یادگیری ماشین شده است.

در دنیای سنتی یادگیری عمیق، هر بار که میخواستیم یک مدل جدید بسازیم، باید میلیونها داده جمعآوری میکردیم، هزاران ساعت GPU میسوزاندیم و هفتهها منتظر میماندیم تا مدل آموزش ببیند. اما Transfer Learning این قواعد بازی را تغییر داد. امروز با کمتر از 100 تصویر و چند ساعت آموزش، میتوانید یک مدل تشخیص تصویر دقیق بسازید که رقیب مدلهای میلیون دلاری باشد.

یادگیری انتقالی چیست؟

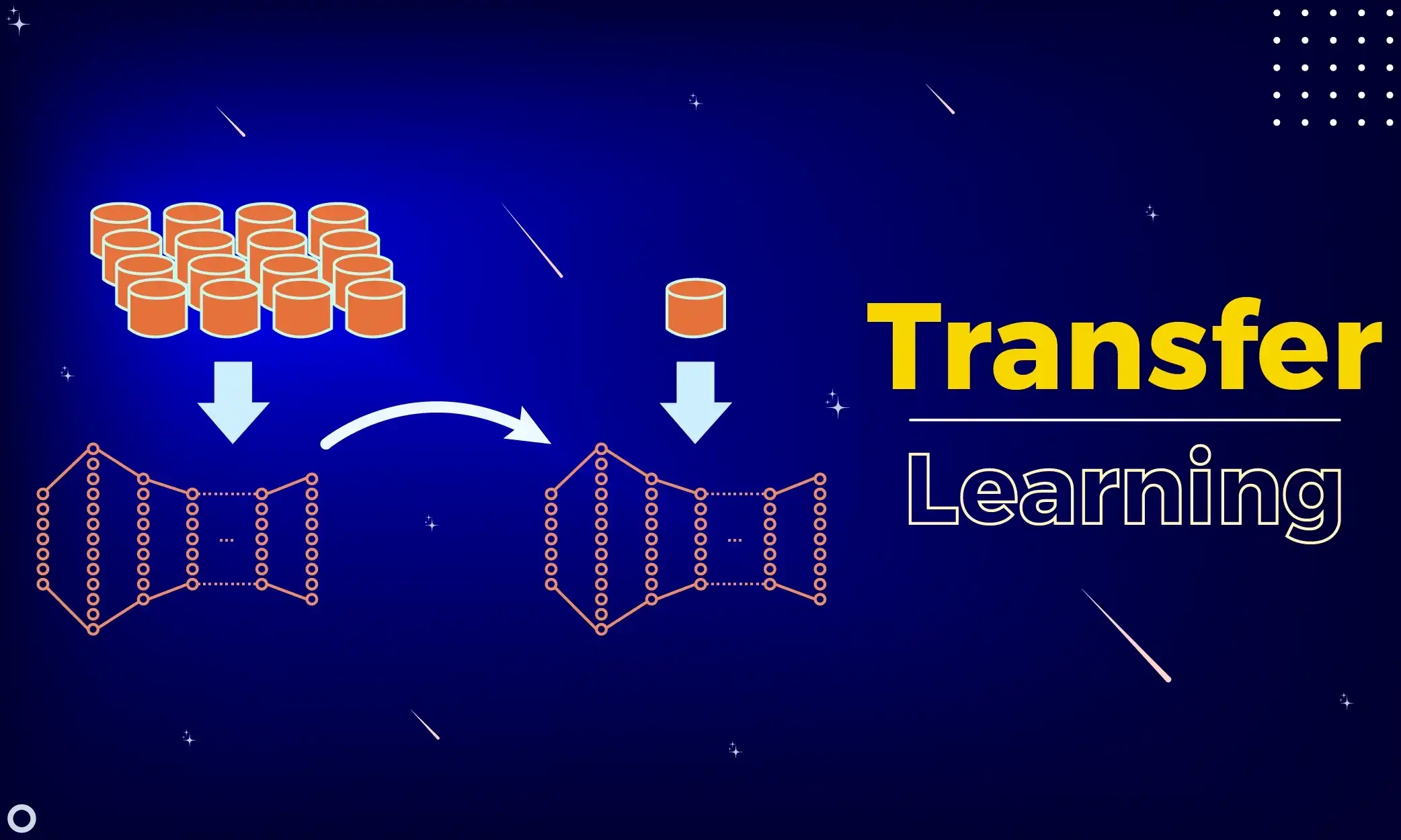

یادگیری انتقالی یک تکنیک در یادگیری عمیق است که در آن دانش به دست آمده از حل یک مسئله را برای حل مسئله دیگری استفاده میکنیم. به جای آموزش یک شبکه عصبی از صفر، از یک مدل از پیش آموزش دیده (Pre-trained Model) شروع میکنیم که روی مجموعه داده عظیمی مثل ImageNet آموزش دیده است.

این مدلهای از پیش آموزش دیده، ویژگیهای عمومی مثل لبهها، بافتها، اشکال و الگوهای پیچیدهتر را یاد گرفتهاند. حالا ما میتوانیم این دانش را به یک حوزه خاص منتقل کنیم و فقط لایههای آخر را برای تشخیص موارد خاص دوباره آموزش دهیم.

چرا یادگیری انتقالی انقلابی است؟

- کاهش چشمگیر داده مورد نیاز: به جای میلیونها تصویر، گاهی با چند صد یا حتی چند ده نمونه میتوانید مدل دقیقی بسازید.

- صرفهجویی عظیم در زمان: آموزش مدل از صفر ممکن است هفتهها طول بکشد، اما با Transfer Learning ممکن است فقط چند ساعت یا حتی دقیقه طول بکشد.

- کاهش هزینه محاسباتی: دیگر نیازی به سرورهای قدرتمند و GPUهای گرانقیمت برای آموزش اولیه نیست.

- دقت بالاتر با داده کمتر: مدلهای از پیش آموزش دیده معمولاً عملکرد بهتری نسبت به مدلهای آموزش داده شده از صفر با داده محدود دارند.

انواع یادگیری انتقالی

1. Feature Extraction (استخراج ویژگی)

در این روش، از مدل از پیش آموزش دیده به عنوان یک استخراجکننده ویژگی استفاده میکنیم. وزنهای لایههای اولیه ثابت نگه داشته میشوند و فقط لایههای آخر (که معمولاً لایههای کاملاً متصل هستند) دوباره آموزش داده میشوند.

مثال عملی: فرض کنید میخواهید یک سیستم تشخیص خودکار بیماری پوستی بسازید. میتوانید از مدل ResNet50 که روی ImageNet آموزش دیده استفاده کنید. این مدل قبلاً یاد گرفته است که لبهها، رنگها و بافتها را تشخیص دهد. شما فقط باید لایه آخر را تغییر دهید تا به جای 1000 کلاس ImageNet، انواع بیماریهای پوستی را تشخیص دهد.

2. Fine-Tuning (تنظیم دقیق)

در این روش، علاوه بر آموزش لایههای آخر، برخی از لایههای عمیقتر شبکه را نیز با نرخ یادگیری پایینتر دوباره آموزش میدهیم. این کار به مدل اجازه میدهد که ویژگیهای سطح بالاتر را برای مسئله خاص ما تطبیق دهد.

مثال عملی: یک استارتاپ میخواهد سیستم تشخیص چهره برای حضور و غیاب کارمندان بسازد. با استفاده از مدل VGGFace که روی میلیونها چهره آموزش دیده، شروع میکنند. سپس لایههای آخر را دوباره آموزش میدهند تا چهرههای خاص کارمندان شرکت را یاد بگیرد.

3. Domain Adaptation (تطبیق حوزه)

زمانی استفاده میشود که توزیع دادههای منبع و هدف متفاوت است. هدف کاهش شکاف بین دو حوزه است.

مثال عملی: یک مدل تشخیص شیء آموزش دیده روی تصاویر روز را برای تشخیص در تصاویر شب تطبیق دهیم.

کاربردهای شگفتانگیز یادگیری انتقالی

1. تشخیص پزشکی با دقت فوقالعاده

یکی از جذابترین کاربردهای Transfer Learning در تشخیص و درمان هوش مصنوعی است. بیمارستانها و مراکز تحقیقاتی از مدلهای از پیش آموزش دیده مثل InceptionV3 برای تشخیص سرطان پوست، تومورهای مغزی و بیماریهای چشمی استفاده میکنند.

داستان واقعی: پژوهشگران دانشگاه استنفورد با استفاده از Transfer Learning، مدلی ساختند که میتواند سرطان پوست را با دقت معادل متخصصان پوست تشخیص دهد. جالب اینجاست که این مدل فقط با 130,000 تصویر آموزش داده شده بود - عددی که برای آموزش از صفر بسیار کم است.

2. پردازش زبان طبیعی و مدلهای زبانی

در حوزه پردازش زبان طبیعی، مدلهایی مثل BERT، GPT و مدلهای زبانی دیگر از Transfer Learning استفاده میکنند. این مدلها ابتدا روی میلیاردها کلمه از اینترنت آموزش داده میشوند و سپس برای کارهای خاص مثل تحلیل احساسات، ترجمه ماشینی یا خلاصهسازی متن تنظیم دقیق میشوند.

مثال کاربردی: یک شرکت تجارت الکترونیک میخواهد نظرات مشتریان را تحلیل کند. به جای آموزش یک مدل از صفر با میلیونها نظر، میتواند از BERT که قبلاً زبان را فهمیده است استفاده کند و فقط با چند هزار نظر برچسبگذاری شده، مدل دقیقی برای تحلیل احساسات بسازد.

3. تشخیص اشیاء و خودروهای خودران

در صنعت خودرو، هوش مصنوعی در صنعت خودرو و خودروهای خودران از Transfer Learning برای تشخیص عابرین پیاده، خودروها، علائم راهنمایی و موانع استفاده میکنند. مدلهای شبکههای عصبی کانولوشنال (CNN) مثل YOLO و Faster R-CNN از پیش روی مجموعه دادههای عظیمی آموزش دیدهاند.

کاربرد عملی: تسلا از مدلهای Transfer Learning برای بهبود سیستم Autopilot خود استفاده میکند. این مدلها ابتدا روی میلیونها تصویر عمومی آموزش دیدهاند و سپس با دادههای واقعی از خودروهای در حال حرکت تنظیم دقیق میشوند.

4. ساخت محتوای خلاقانه

در حوزه هوش مصنوعی مولد، مدلهایی مثل Stable Diffusion و GANs از Transfer Learning استفاده میکنند. یک هنرمند دیجیتال میتواند با چند نمونه از سبک کاری خود، یک مدل شخصیسازی شده بسازد که آثار هنری جدید در همان سبک تولید کند.

داستان موفقیت: یک استودیوی انیمیشن کوچک با استفاده از Transfer Learning و تنظیم دقیق مدلهای تولید تصویر، توانست در کسری از زمان و هزینه معمول، پسزمینههای باکیفیت برای انیمیشن خود تولید کند.

5. تجارت الکترونیک و توصیه محصول

سیستمهای توصیه در فروشگاههای آنلاین از Transfer Learning برای درک بهتر ترجیحات مشتریان استفاده میکنند. یک مدل که روی دادههای عمومی خرید کاربران آموزش دیده، میتواند سریعاً برای یک فروشگاه خاص تنظیم شود.

6. کشاورزی هوشمند

در کشاورزی هوشمند، کشاورزان از مدلهای Transfer Learning برای تشخیص بیماریهای گیاهی، تخمین عملکرد محصول و بهینهسازی مصرف آب استفاده میکنند. با چند صد عکس از گیاهان بیمار، میتوان مدلی ساخت که بیماریهای مختلف را با دقت بالا تشخیص دهد.

مدلهای محبوب از پیش آموزش دیده

برای بینایی کامپیوتری:

- ResNet: با معماری باقیمانده (Residual) که امکان آموزش شبکههای بسیار عمیق را فراهم میکند.

- VGG: با ساختار ساده و قدرتمند برای استخراج ویژگیهای بصری.

- InceptionV3: با استفاده از کانولوشنهای موازی در اندازههای مختلف.

- EfficientNet: با تعادل بهینه بین دقت و سرعت.

- Vision Transformers (ViT): معماری جدید مبتنی بر Transformer با عملکرد فوقالعاده.

برای پردازش زبان طبیعی:

- BERT: برای درک دوطرفه متن و کارهای تحلیلی.

- GPT: برای تولید متن و کارهای زبانی مختلف.

- T5: مدل Text-to-Text که تمام کارهای NLP را به یک فرمت واحد تبدیل میکند.

- Claude و ChatGPT: مدلهای گفتگو که از Transfer Learning برای تنظیم دقیق استفاده میکنند.

چگونه یادگیری انتقالی را پیادهسازی کنیم؟

با استفاده از TensorFlow و Keras

python

from tensorflow.keras.applications import ResNet50

این کد نشان میدهد که چگونه میتوانید با چند خط ساده، از قدرت یک مدل میلیون دلاری استفاده کنید.

با استفاده از PyTorch

PyTorch نیز امکانات عالی برای Transfer Learning ارائه میدهد:

python

import torch

نکات طلایی برای موفقیت در Transfer Learning

1. انتخاب مدل مناسب

مدل از پیش آموزش دیده باید روی دادههایی شبیه به مسئله شما آموزش دیده باشد. برای مثال، اگر میخواهید تصاویر پزشکی را تحلیل کنید، استفاده از مدلی که روی تصاویر پزشکی آموزش دیده، بهتر از مدلی است که فقط روی ImageNet آموزش دیده.

2. Data Augmentation (افزایش داده)

حتی با Transfer Learning، استفاده از تکنیکهای افزایش داده مثل چرخش، برش، تغییر نور و... میتواند دقت مدل را بهبود بخشد.

3. نرخ یادگیری مناسب

برای Fine-Tuning، از نرخ یادگیری پایینتری نسبت به آموزش از صفر استفاده کنید. معمولاً نرخ یادگیری بین 0.0001 تا 0.001 مناسب است.

4. تنظیم تدریجی لایهها

ابتدا فقط لایههای آخر را آموزش دهید، سپس به تدریج لایههای عمیقتر را باز کنید (unfreeze) و با نرخ یادگیری پایین آموزش دهید.

5. استفاده از Regularization

تکنیکهایی مثل Dropout و L2 Regularization میتوانند از Overfitting جلوگیری کنند، خصوصاً وقتی داده محدود دارید.

چالشها و محدودیتها

1. مشکل تطبیق حوزه

اگر دادههای شما بسیار متفاوت از دادههای آموزش اولیه باشند، Transfer Learning ممکن است عملکرد خوبی نداشته باشد. برای مثال، استفاده از مدل آموزش دیده روی تصاویر طبیعی برای تحلیل تصاویر رادار.

2. Negative Transfer

گاهی اوقات انتقال دانش میتواند عملکرد را بدتر کند. این اتفاق زمانی میافتد که دو مسئله واقعاً هیچ شباهتی به هم ندارند.

3. حافظه و منابع محاسباتی

مدلهای بزرگ از پیش آموزش دیده نیاز به حافظه زیادی دارند. برای مثال، مدلهای Transformer بزرگ ممکن است چندین گیگابایت فضا اشغال کنند.

4. حقوق مالکیت و مجوز

برخی مدلهای از پیش آموزش دیده محدودیتهای مجوز دارند که باید قبل از استفاده تجاری بررسی شوند.

آینده یادگیری انتقالی

1. Few-Shot و Zero-Shot Learning

یادگیری Few-Shot قدم بعدی در تکامل Transfer Learning است. مدلهایی که با دیدن فقط چند نمونه میتوانند کار جدیدی یاد بگیرند.

2. Meta-Learning

مدلهایی که یاد میگیرند چگونه یاد بگیرند. این مدلها میتوانند خیلی سریعتر به کارهای جدید سازگار شوند.

3. Self-Supervised Learning

یادگیری خودنظارتی که در آن مدلها بدون نیاز به برچسبگذاری دستی، از دادهها یاد میگیرند. این رویکرد آینده Transfer Learning را روشنتر میکند.

4. Multi-Modal Transfer Learning

انتقال دانش بین حوزههای مختلف مثل تصویر، متن و صوت. مدلهای چندوجهی (Multimodal) مثل CLIP و Flamingo از این نوع یادگیری استفاده میکنند.

5. Domain Generalization

مدلهایی که میتوانند روی حوزههای مختلف بدون نیاز به تنظیم دقیق کار کنند.

Transfer Learning در صنایع مختلف

صنعت مالی

در تحلیل مالی با هوش مصنوعی، بانکها و موسسات مالی از Transfer Learning برای تشخیص تقلب، پیشبینی قیمت سهام و ارزیابی ریسک استفاده میکنند.

صنعت خردهفروشی

فروشگاههای زنجیرهای از این تکنیک برای تحلیل رفتار مشتری، پیشبینی تقاضا و مدیریت موجودی استفاده میکنند.

صنعت امنیت سایبری

در امنیت سایبری، مدلهای Transfer Learning برای شناسایی بدافزارهای جدید، تشخیص حملات شبکه و محافظت از سیستمها استفاده میشوند.

صنعت تولید

در کارخانهها، از Transfer Learning برای کنترل کیفیت، تشخیص نقص و نگهداری پیشبینانه استفاده میشود.

ابزارها و کتابخانههای کاربردی

TensorFlow Hub

مخزنی از مدلهای از پیش آموزش دیده آماده استفاده که میتوانید با چند خط کد در پروژه خود بارگذاری کنید.

Hugging Face

پلتفرمی عالی برای مدلهای پردازش زبان طبیعی با هزاران مدل آماده و مستندات کامل.

PyTorch Hub

مشابه TensorFlow Hub اما برای PyTorch با مجموعهای از مدلهای معروف.

ONNX

فرمتی برای انتقال مدلها بین فریمورکهای مختلف که انعطافپذیری بالایی ارائه میدهد.

FastAI

کتابخانهای که Transfer Learning را بسیار ساده میکند و با API کاربرپسند، امکان آموزش سریع مدلها را فراهم میآورد.

مقایسه Transfer Learning با روشهای دیگر

| روش | زمان آموزش | داده مورد نیاز | دقت | هزینه محاسباتی |

|---|---|---|---|---|

| آموزش از صفر | چند هفته | میلیونها نمونه | بالا (با داده کافی) | بسیار بالا |

| Transfer Learning | چند ساعت | صدها تا هزاران نمونه | بالا | متوسط |

| Few-Shot Learning | دقایق | چند نمونه | متوسط تا بالا | کم |

این جدول نشان میدهد که چرا Transfer Learning گزینه محبوب برای بیشتر پروژههای عملی است.

نکات امنیتی و اخلاقی

حریم خصوصی

مدلهای از پیش آموزش دیده ممکن است اطلاعات حساسی از دادههای آموزش اولیه را حفظ کرده باشند. این موضوع در حریم خصوصی در عصر هوش مصنوعی بسیار مهم است.

سوگیری (Bias)

اگر مدل اولیه روی دادههای مغرضانه آموزش دیده باشد، این سوگیری به مدل جدید شما منتقل میشود. برای اخلاق در هوش مصنوعی باید مراقب باشید.

شفافیت

استفاده از مدلهای بلکباکس میتواند مشکلاتی در قابلیت تفسیر هوش مصنوعی ایجاد کند.

تکنیکهای پیشرفته در Transfer Learning

1. Progressive Neural Networks

این معماری به شبکه اجازه میدهد که دانش جدید را یاد بگیرد بدون اینکه دانش قبلی را فراموش کند. هر کار جدید، یک ستون جدید به شبکه اضافه میکند که به ستونهای قبلی متصل است.

2. Multi-Task Learning

به جای اینکه یک مدل را برای یک کار تنظیم کنیم، میتوانیم آن را برای چندین کار مرتبط همزمان آموزش دهیم. این کار باعث میشود مدل ویژگیهای کلیتر و قابل انتقالتری یاد بگیرد.

3. Knowledge Distillation

فرآیندی که در آن دانش یک مدل بزرگ و قدرتمند (Teacher) به یک مدل کوچکتر و کارآمدتر (Student) منتقل میشود. این تکنیک برای استقرار مدلها روی دستگاههای موبایل و Edge AI بسیار مفید است.

4. Adapter Modules

به جای تنظیم دقیق کل شبکه، ماژولهای کوچکی اضافه میکنیم که فقط آنها آموزش داده میشوند. این روش کارآمد و مقیاسپذیر است.

5. Low-Rank Adaptation (LoRA)

LoRA یک تکنیک نوین است که به جای تنظیم تمام پارامترها، ماتریسهای کم رتبهای اضافه میکند. این روش برای مدلهای زبانی بزرگ بسیار کارآمد است.

مطالعات موردی واقعی

مطالعه موردی 1: استارتاپ سلامت دیجیتال

یک استارتاپ میخواست اپلیکیشنی بسازد که بیماریهای پوستی را از روی عکس تشخیص دهد. با بودجه محدود و فقط 5000 تصویر برچسبگذاری شده:

- روش: استفاده از EfficientNetB4 از پیش آموزش دیده روی ImageNet

- زمان آموزش: 6 ساعت روی یک GPU

- نتیجه: دقت 94% در تشخیص 10 نوع بیماری پوستی رایج

- صرفهجویی: در مقایسه با آموزش از صفر، 95% کاهش هزینه و زمان

مطالعه موردی 2: شرکت تولیدی

یک کارخانه تولید قطعات الکترونیک میخواست سیستم خودکار کنترل کیفیت بسازد:

- روش: Fine-tuning مدل ResNet50 با 2000 تصویر از نقصهای مختلف

- زمان آموزش: 3 ساعت

- نتیجه: کاهش 80% در نقصهای گذرانده شده و افزایش 40% سرعت بررسی

- ROI: بازگشت سرمایه در 3 ماه

مطالعه موردی 3: پلتفرم آموزش آنلاین

یک پلتفرم آموزشی میخواست سیستم خودکار تصحیح مقالات دانشجویی بسازد:

- روش: Fine-tuning مدل BERT برای ارزیابی کیفیت نوشتار

- داده: 10,000 مقاله با نمرههای معلمان

- نتیجه: همبستگی 0.89 با نمرات معلمان انسانی

- تأثیر: کاهش 70% زمان تصحیح معلمان

بهینهسازی عملکرد

1. Mixed Precision Training

استفاده از اعداد با دقت مختلف (float16 و float32) میتواند سرعت آموزش را تا 3 برابر افزایش دهد.

2. Gradient Accumulation

وقتی حافظه GPU محدود است، میتوانیم Gradient را در چند مرحله جمع کنیم و سپس وزنها را بهروزرسانی کنیم.

3. Learning Rate Scheduling

استفاده از نرخ یادگیری متغیر مثل Cosine Annealing یا One Cycle Policy میتواند دقت را بهبود بخشد.

4. Early Stopping

توقف آموزش زمانی که عملکرد روی دادههای اعتبارسنجی دیگر بهبود نمییابد، از Overfitting جلوگیری میکند.

ترکیب با تکنیکهای دیگر

Transfer Learning + AutoML

ترکیب Transfer Learning با یادگیری خودکار میتواند بهترین معماری و هایپرپارامترها را خودکار پیدا کند.

Transfer Learning + Federated Learning

یادگیری فدرال اجازه میدهد مدلها را روی دادههای پراکنده بدون انتقال داده آموزش دهیم و Transfer Learning میتواند نقطه شروع خوبی باشد.

Transfer Learning + Active Learning

با انتخاب هوشمند نمونههایی که برای برچسبگذاری مفیدترند، میتوانیم با داده کمتری به دقت بالاتر برسیم.

راهنمای عملی گام به گام

گام 1: تعریف مسئله

مشخص کنید دقیقاً چه کاری میخواهید انجام دهید. آیا یک مسئله classification است یا detection؟ چند کلاس دارید؟

گام 2: جمعآوری و آمادهسازی داده

- حداقل 100-200 نمونه برای هر کلاس جمعآوری کنید

- دادهها را به train/validation/test تقسیم کنید (معمولاً 70/15/15)

- Data Augmentation اعمال کنید

گام 3: انتخاب مدل پایه

بر اساس مسئله و منابع موجود، یک مدل از پیش آموزش دیده انتخاب کنید.

گام 4: آموزش اولیه

ابتدا فقط لایههای آخر را با نرخ یادگیری معمولی (0.001) آموزش دهید.

گام 5: Fine-Tuning

لایههای عمیقتر را باز کنید و با نرخ یادگیری کمتر (0.0001) آموزش دهید.

گام 6: ارزیابی و بهینهسازی

عملکرد را روی دادههای test بررسی کنید و در صورت نیاز هایپرپارامترها را تنظیم کنید.

گام 7: استقرار

مدل را در محیط production مستقر کنید و عملکرد را مانیتور کنید.

منابع یادگیری بیشتر

کتابها

- "Deep Learning with Python" by François Chollet

- "Hands-On Transfer Learning with Python" by Dipanjan Sarkar

- "Transfer Learning for Natural Language Processing" by Paul Azunre

دورههای آنلاین

- Fast.ai Practical Deep Learning for Coders

- Coursera: Deep Learning Specialization

- Udacity: Deep Learning Nanodegree

مقالات علمی

برای درک عمیقتر، مقالات اصلی مثل "ImageNet Classification with Deep Convolutional Neural Networks" و "BERT: Pre-training of Deep Bidirectional Transformers" را مطالعه کنید.

نتیجهگیری

یادگیری انتقالی یکی از مهمترین پیشرفتهای دهه اخیر در یادگیری ماشین است. این تکنیک نه تنها هزینه و زمان توسعه را کاهش داده، بلکه هوش مصنوعی را برای افراد و سازمانهای کوچکتر نیز در دسترس قرار داده است.

امروزه دیگر نیازی نیست تیمی از محققان، میلیونها دلار بودجه و ماهها زمان داشته باشید تا یک مدل دقیق بسازید. با Transfer Learning، یک توسعهدهنده یا پژوهشگر میتواند با لپتاپ شخصی و چند ساعت کار، مدلی بسازد که رقیب جدی مدلهای صنعتی باشد.

آینده Transfer Learning با ظهور تکنیکهای جدید مثل Few-Shot Learning، Meta-Learning و مدلهای خودبهبودیافته روشنتر از همیشه است. با یادگیری این تکنیک، شما نه تنها در دنیای امروز هوش مصنوعی رقابتی میمانید، بلکه برای آینده هوش مصنوعی نیز آماده خواهید بود.

حالا وقت آن است که شروع کنید. یک پروژه کوچک انتخاب کنید، یک مدل از پیش آموزش دیده بارگذاری کنید و قدرت Transfer Learning را تجربه کنید. موفق باشید!

✨

با دیپفا، دنیای هوش مصنوعی در دستان شماست!!

🚀به دیپفا خوش آمدید، جایی که نوآوری و هوش مصنوعی با هم ترکیب میشوند تا دنیای خلاقیت و بهرهوری را دگرگون کنند!

- 🔥 مدلهای زبانی پیشرفته: از Dalle، Stable Diffusion، Gemini 2.5 Pro، Claude 4.5، GPT-5 و دیگر مدلهای قدرتمند بهرهبرداری کنید و محتوای بینظیری خلق کنید که همگان را مجذوب خود کند.

- 🔥 تبدیل متن به صدا و بالتصویر: با فناوریهای پیشرفته ما، به سادگی متنهای خود را به صدا تبدیل کنید و یا از صدا، متنهای دقیق و حرفهای بسازید.

- 🔥 تولید و ویرایش محتوا: از ابزارهای ما برای خلق متنها، تصاویر و ویدئوهای خیرهکننده استفاده کنید و محتوایی بسازید که در یادها بماند.

- 🔥 تحلیل داده و راهکارهای سازمانی: با پلتفرم API ما، تحلیل دادههای پیچیده را به سادگی انجام دهید و بهینهسازیهای کلیدی برای کسبوکار خود را به عمل آورید.

✨ با دیپفا، به دنیای جدیدی از امکانات وارد شوید! برای کاوش در خدمات پیشرفته و ابزارهای ما، به وبسایت ما مراجعه کنید و یک قدم به جلو بردارید:

کاوش در خدمات مادیپفا همراه شماست تا با ابزارهای هوش مصنوعی فوقالعاده، خلاقیت خود را به اوج برسانید و بهرهوری را به سطحی جدید برسانید. اکنون وقت آن است که آینده را با هم بسازیم!